OpenAI revela una innovadora metodología para supervisar el proceso interno de razonamiento de sus modelos, marcando un hito en la fiabilidad y control de las aplicaciones de inteligencia artificial.

En un contexto donde la seguridad y la interpretabilidad de la inteligencia artificial son aspectos cada vez más determinantes para el éxito de las aplicaciones empresariales, OpenAI ha presentado su nueva iniciativa denominada “Chain-of-Thought Monitoring”.

Esta metodología está diseñada para examinar y evaluar en tiempo real el proceso interno de razonamiento – conocido como “chain-of-thought” – que utilizan los modelos de lenguaje para generar respuestas complejas y tomar decisiones.

La técnica surge como respuesta a la creciente necesidad de comprender y supervisar cómo los modelos de IA razonan internamente antes de emitir un resultado. Un portavoz de OpenAI explicó que “Chain-of-Thought Monitoring nos permite detectar desviaciones en el razonamiento del modelo, lo que a su vez contribuye a mejorar la seguridad y la precisión de las respuestas”.

Estas palabras subrayan el compromiso de la compañía por garantizar que las decisiones automatizadas se basen en procesos coherentes y transparentes, reduciendo los riesgos de errores o interpretaciones equivocadas en aplicaciones críticas.

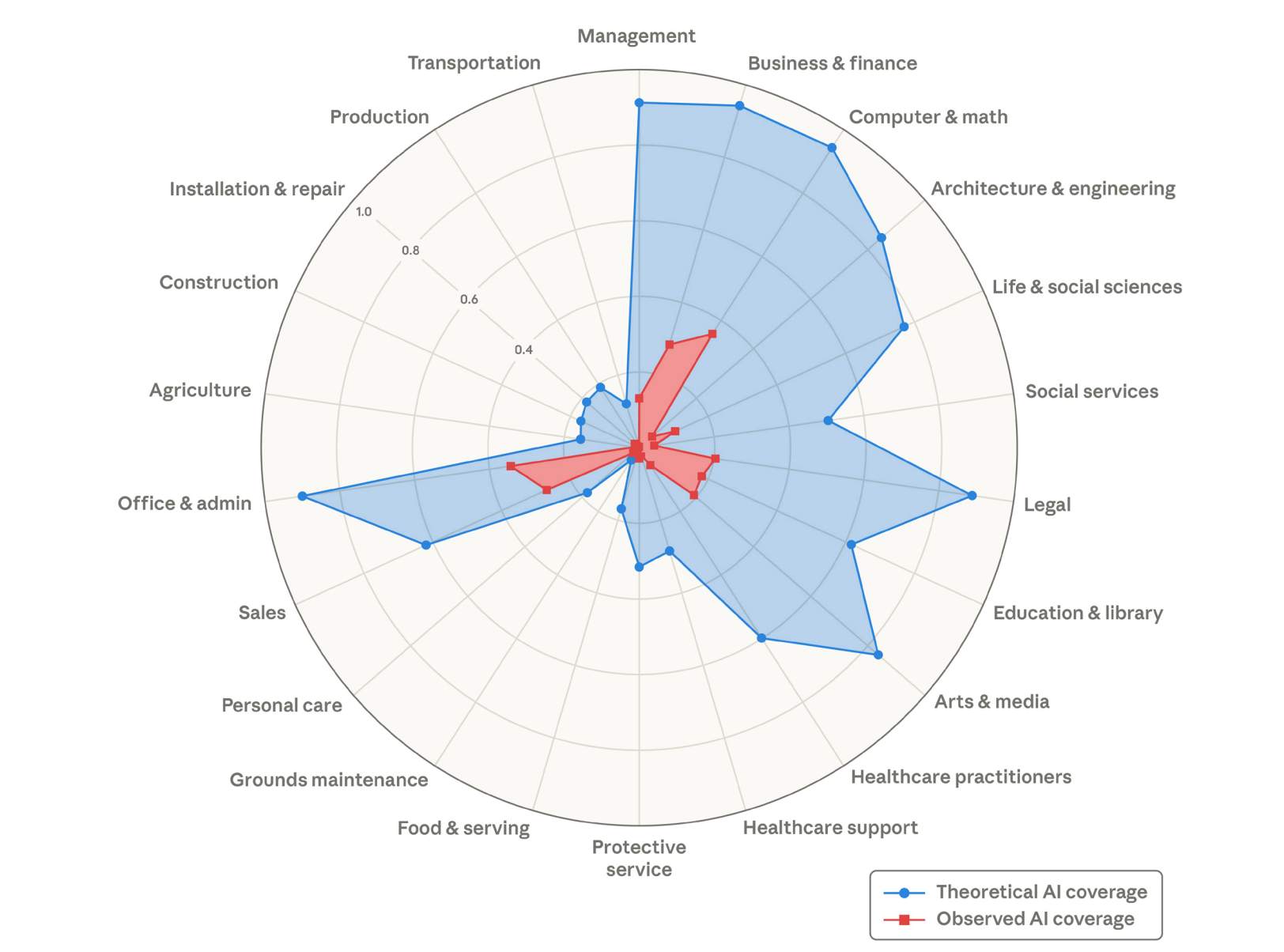

La implementación de esta metodología tiene implicaciones directas en el mundo de los negocios, especialmente en sectores que dependen de sistemas de IA para tareas como atención al cliente, análisis de datos y soporte en tiempo real. Empresas que integren estas soluciones podrán contar con una capa adicional de seguridad, ya que la monitorización del “chain-of-thought” permite identificar y corregir posibles desviaciones en el proceso de toma de decisiones.

Aunque OpenAI no ha revelado cifras exactas en cuanto a la mejora cuantitativa que esta técnica aporta, se estima que la precisión de los modelos podría incrementarse significativamente, lo que se traduciría en una mayor confianza por parte de inversores y clientes.

Además, el desarrollo de “Chain-of-Thought Monitoring” se enmarca en la tendencia de hacer la inteligencia artificial más interpretable y controlable.

Los expertos coinciden en que la transparencia en el proceso de razonamiento de la IA es esencial para evitar sesgos y errores que puedan tener consecuencias negativas en contextos empresariales y regulatorios.

La capacidad de monitorizar el razonamiento interno ofrece a los desarrolladores la oportunidad de realizar ajustes en tiempo real y optimizar el rendimiento de los modelos.

Por otro lado, esta innovación también abre la puerta a nuevas oportunidades de colaboración entre empresas tecnológicas y organismos reguladores. En un entorno donde las inversiones en IA superan los U$S 500 mil millones a nivel global, contar con herramientas que aseguren el buen funcionamiento de estos sistemas se vuelve un elemento diferenciador para las compañías que buscan consolidar su posición en el mercado. La transparencia en el proceso de razonamiento no solo refuerza la seguridad operativa, sino que también mejora la capacidad de las empresas para cumplir con normativas y estándares éticos cada vez más exigentes.

Otro aspecto relevante es la capacidad de “Chain-of-Thought Monitoring” para actuar como una herramienta de diagnóstico en el entrenamiento de modelos de IA. Al analizar detalladamente cada paso del proceso de razonamiento, los desarrolladores pueden identificar patrones problemáticos o áreas de mejora en el modelo.

Esto no solo permite optimizar el rendimiento, sino que también facilita la detección temprana de posibles fallos, lo que es crucial para aplicaciones en sectores sensibles como el financiero o el sanitario.

En definitiva, la introducción de “Chain-of-Thought Monitoring” representa un avance decisivo en la evolución de la inteligencia artificial. Con esta innovación, OpenAI refuerza su liderazgo en la creación de sistemas más seguros, transparentes y eficientes, elementos clave para el crecimiento y la transformación digital en el ámbito de los negocios.

El futuro de la IA se perfila con mayor claridad y confianza, gracias a tecnologías que permiten conocer el “pensamiento” interno de los modelos y asegurar que cada decisión se alinee con los estándares más altos de seguridad y precisión.