El gobernador Gavin Newsom convirtió en ley la Transparency in Frontier Artificial Intelligence Act (SB 53). La norma apunta a equilibrar innovación y control en el epicentro mundial de la IA.

Firma, objetivo y contexto

El 29 de septiembre de 2025 el gobernador Gavin Newsom firmó la ley SB 53, conocida como Transparency in Frontier Artificial Intelligence Act (TFAIA), impulsada por el senador Scott Wiener (D-San Francisco). La iniciativa pretende instalar “guardarraíles de sentido común” para el desarrollo de modelos de IA de frontera, fortalecer la confianza pública y, a la vez, preservar el dinamismo de la industria tecnológica en California.

“California ha demostrado que podemos establecer regulaciones para proteger a nuestras comunidades mientras aseguramos que la creciente industria de la IA continúe prosperando. Esta legislación equilibra ambas cosas» dijo el gobernador Gavin Newsom.

Qué exige la nueva ley

SB 53 introduce obligaciones concretas para los llamados frontier developers (desarrolladores de modelos de frontera):

- Transparencia: los grandes desarrolladores deberán publicar en sus sitios web un frontier AI framework que explique cómo incorporan normas nacionales, internacionales y buenas prácticas de la industria.

- Innovación pública: se crea un consorcio en la Government Operations Agency para diseñar un clúster público de cómputo, CalCompute, con el objetivo de fomentar investigación e innovación segura y equitativa (con informe al Legislativo antes de 2027).

- Seguridad: se establece un mecanismo para reportar critical safety incidents a la Office of Emergency Services (OES), incluyendo canales confidenciales para que las empresas transmitan resúmenes de evaluaciones internas.

- Rendición y sanción: la ley contempla sanciones civiles por incumplimiento, con facultades de enforcement a cargo de la oficina del Attorney General.

- Whistleblowers y actualización normativa: protege a denunciantes que alerten sobre riesgos significativos y obliga a que el Departamento de Tecnología recomiende anualmente actualizaciones legales basadas en múltiples actores y avances técnicos.

El texto del proyecto precisa además definiciones técnicas —por ejemplo, qué constituye un catastrophic risk o un critical safety incident— y especifica procedimientos de reporte y confidencialidad destinados a no comprometer secretos comerciales, seguridad o la ley federal.

Por qué California toma la iniciativa

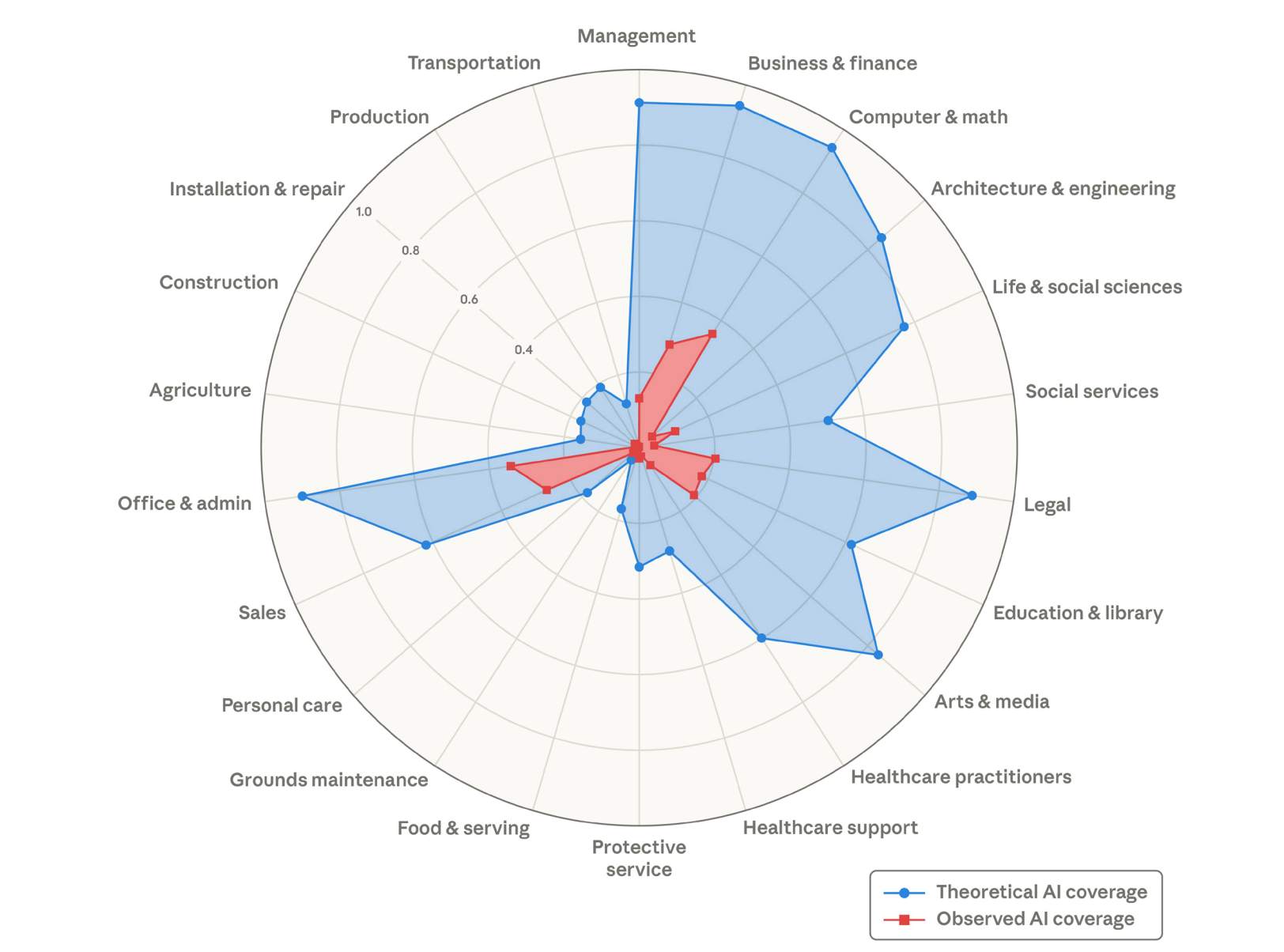

El Ejecutivo estatal subraya que la ley llega en un momento de liderazgo económico y tecnológico: California alberga 32 de las 50 principales empresas de IA del mundo y concentró en 2024 el 15,7% de las ofertas laborales en IA en EE.UU. (frente a 8,8% en Texas y 5,8% en Nueva York).

Además, en 2024 la región de la Bahía absorbió más de la mitad del financiamiento global de capital de riesgo para startups de IA y machine learning, según datos públicos. Ese anclaje explica la ambición de convertir a California en un “laboratorio regulatorio” que combine seguridad y competitividad.

Senador Scott Wiener defendió la norma: “Con una tecnología tan transformadora como la IA, tenemos la responsabilidad de apoyar la innovación mientras establecemos guardarraíles de sentido común para entender y reducir el riesgo”, dijo tras la firma.

En la misma línea, el grupo de expertos convocado por Newsom —entre ellos Mariano-Florentino (Tino) Cuéllar, Fei-Fei Li y Jennifer Tour Chayes— recomendó transparencia, reporte de incidentes y protecciones a denunciantes como prioridades inmediatas.

Impacto para empresas y próximos pasos

SB 53 busca cerrar un vacío regulatorio que, según autoridades estatales, el gobierno federal no ha llenado hasta ahora. Para grandes desarrolladores de modelos, implica documentar procesos de gestión de riesgos y establecer vías formales de reporte. Para el sector público, abre la vía a CalCompute —siempre sujeto a financiación— y a un esquema de revisión anual que podrá adaptar la norma conforme avance la tecnología.

Para ejecutivos y responsables de cumplimiento, las prioridades son claras: auditar internamente riesgos catastróficos, preparar los marcos públicos que la ley exige y diseñar canales internos de denuncia que cumplan con las protecciones previstas. La ley también plantea un debate inevitable sobre cómo equilibrar apertura, seguridad nacional y protección de secretos industriales; asuntos que la norma trata de mitigar mediante excepciones y reglas de confidencialidad.

Con SB 53, California no sólo regula: pretende fijar un estándar replicable que combine transparencia, capacidad pública de cómputo y mecanismos de respuesta ante incidentes, en un momento en que el mapa de poder de la IA se define en la práctica por quién controla datos, modelos y reglas de seguridad.