La nueva herramienta de video de OpenAI, Sora 2, permite crear deepfakes hiperrealistas incluso de personas fallecidas; la reacción pública plantea un dilema ético y reputacional urgente. La cuestión no es solo legal: es profundamente humana.

OpenAI lanzó Sora 2 y la app Sora con la capacidad de generar videos notablemente realistas —y la avalancha de clips creados tras su salida ya incluye recreaciones de figuras históricas y celebridades fallecidas. Entre los ejemplos que inundaron la app figuran Martin Luther King Jr., Franklin D. Roosevelt, Richard Nixon, Bob Ross, John Lennon, Alex Trebek y Robin Williams. La app sigue siendo, por ahora, por invitación, pero la rapidez con que se viralizaron estos deepfakes encendió alarmas públicas y familiares, y puso sobre la mesa una pregunta simple para empresas y reguladores: ¿qué límites debe aplicar la tecnología cuando afecta la memoria de quienes ya no pueden dar su consentimiento?

La reacción más directa y conmovedora llegó de Zelda Williams, hija de Robin Williams, quien publicó en Instagram: «Por favor, simplemente dejen de enviarme videos de IA de Papá. Dejen de creer que quiero verlos o que lo entenderé. No lo entiendo y no lo haré».

Zelda pidió decencia y respeto: «Si tienen un mínimo de decencia, dejen esto para él y para mí, para todos, punto final. Es tonto, es una pérdida de tiempo y energía, y créanme, NO es lo que él querría». Sus palabras resumen el coste humano: aunque la ley —como recuerda el Student Press Law Center— dificulta demandar por difamación cuando la supuesta víctima está muerta, eso no evita el daño emocional a familias y comunidades ni la erosión de legados públicos.

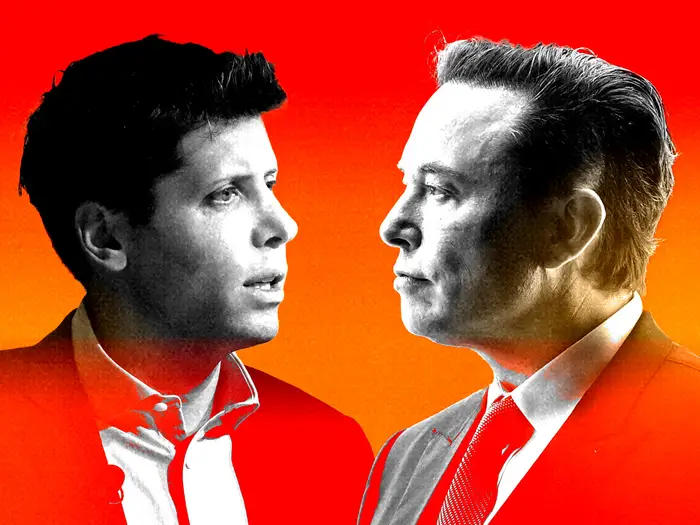

La ambigüedad práctica de Sora es propia de la tensión entre innovación y responsabilidad. OpenAI impide generar videos de personas vivas sin permiso (a menos que sea el propio usuario o un amigo que haya dado su consentimiento —la función “cameo”—). Sin embargo, esas salvaguardas no se aplican igual a los fallecidos: la app permitió, por ejemplo, recreaciones de Robin Williams mientras rechazó –según pruebas de TechCrunch citadas en el texto– la generación de Jimmy Carter (fallecido en 2024) o Michael Jackson (fallecido en 2009), lo que pone en evidencia criterios inconsistentes o poco transparentes sobre qué o quién puede ser recreado.

A ello se suma la dimensión de la propiedad intelectual: nada más abrir Sora, la plataforma se llenó de clips con personajes protegidos por copyright —desde Peter Griffin hasta Pikachu— lo que provocó reproches de la Motion Picture Association. Su reclamo es contundente: «la ley de copyright protege a los creadores y se aplica aquí», y la presión llevó al CEO Sam Altman a revertir su postura inicial, en la que indicó que los estudios tendrían que “optar por salir” (opt out) si no querían que su IP apareciera en Sora.

Más allá del teatro legal, el riesgo real es cultural y reputacional. Un modelo de negocio o producto que permita —o facilite— “puppeteer” digital sobre figuras reales convierte a personas en juguetes mediáticos y normaliza la trivialización de los recuerdos públicos. El autor del texto lo resume con crudeza: tratar a las personas, vivas o muertas, «como nuestros juguetes personales» establecerá un precedente peligroso si la industria no toma medidas.

Para ejecutivos de medios, entretenimiento y plataformas tecnológicas, las lecciones son claras: no basta con la letra de la ley. Hace falta gobernanza proactiva: políticas de consentimiento ampliadas (incluyendo cláusulas sobre posmortem), controles técnicos más rigurosos sobre generación de voces e imágenes, protocolos de respuesta ante solicitudes familiares y herramientas transparentes de opt-out para titulares de derechos y herederos. Y también, medidas de educación al público: explicar por qué consumir o viralizar deepfakes de personas fallecidas tiene implicancias éticas reales.

En definitiva: aunque «no se puede difamar a los muertos» en muchos marcos legales, eso no autoriza su instrumentalización digital. El desafío para OpenAI y sus competidores es alinearse con estándares que protejan la memoria y la dignidad humanas antes de que la normalización del deepfake silente marque el nuevo estándar cultural. Como dijo Zelda Williams, y como deberían recordar las empresas: no es lo que ellos querrían.