El gigante tecnológico integra su IA más avanzada en la app de mapas, ofreciendo una experiencia manos libres y respuestas instantáneas que transforman la forma de recorrer la ciudad.

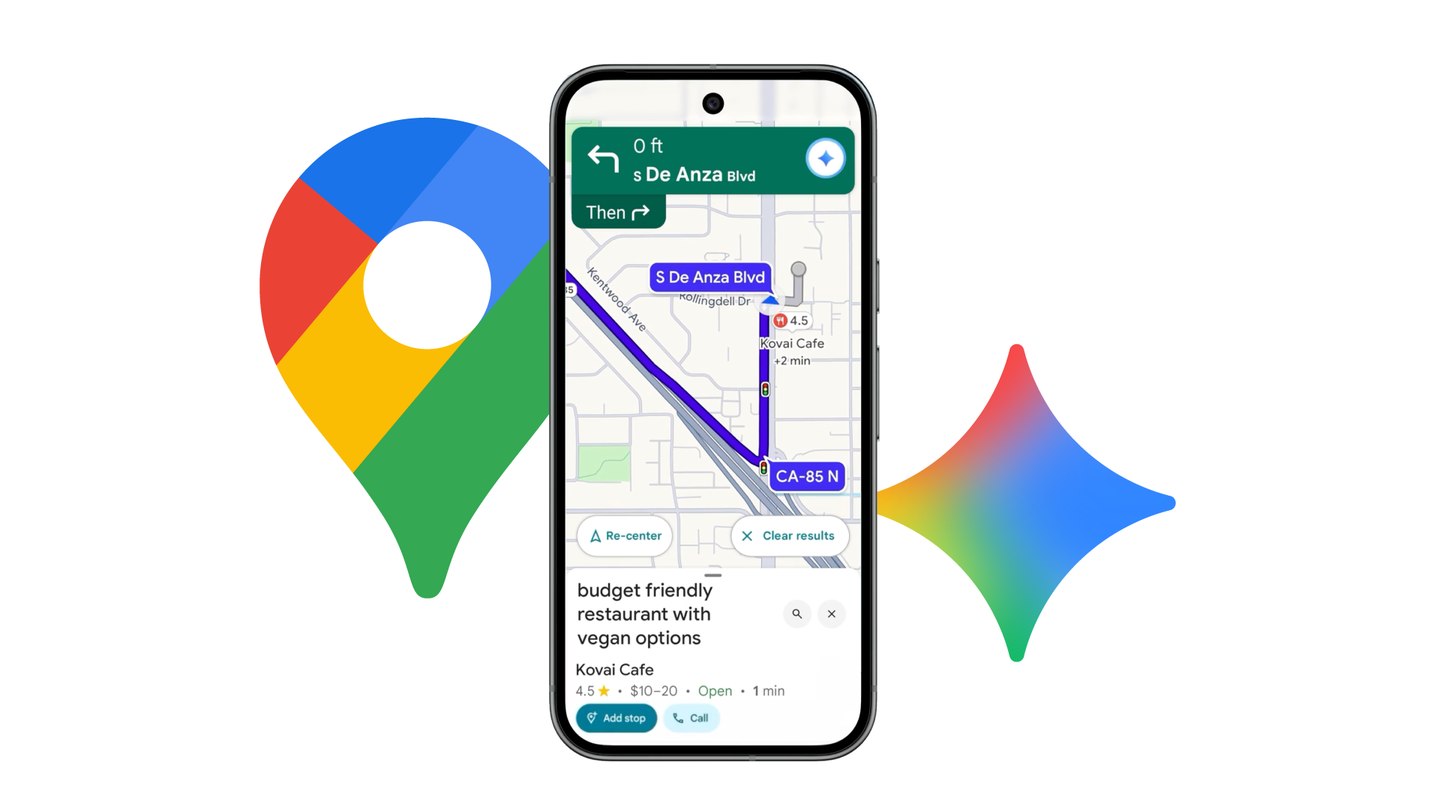

Google lleva más de un año enriqueciendo Maps con funciones basadas en inteligencia artificial, y ahora da otro gran paso con la incorporación de Gemini, su modelo de IA generativa más sofisticado. El objetivo: convertir a Google Maps en un asistente aún más intuitivo y autónomo para millones de conductores y viajeros. El anuncio llega mientras la compañía profundiza su apuesta por experiencias mejoradas en iOS y Android, y confirma que la compatibilidad con Android Auto está muy cerca.

Con Gemini integrado, los usuarios pueden hacer consultas habladas sobre sitios de interés durante su trayecto, obtener información sobre temas generales, como deportes o noticias, e incluso realizar tareas como sumar eventos al calendario, todo sin soltar el volante.

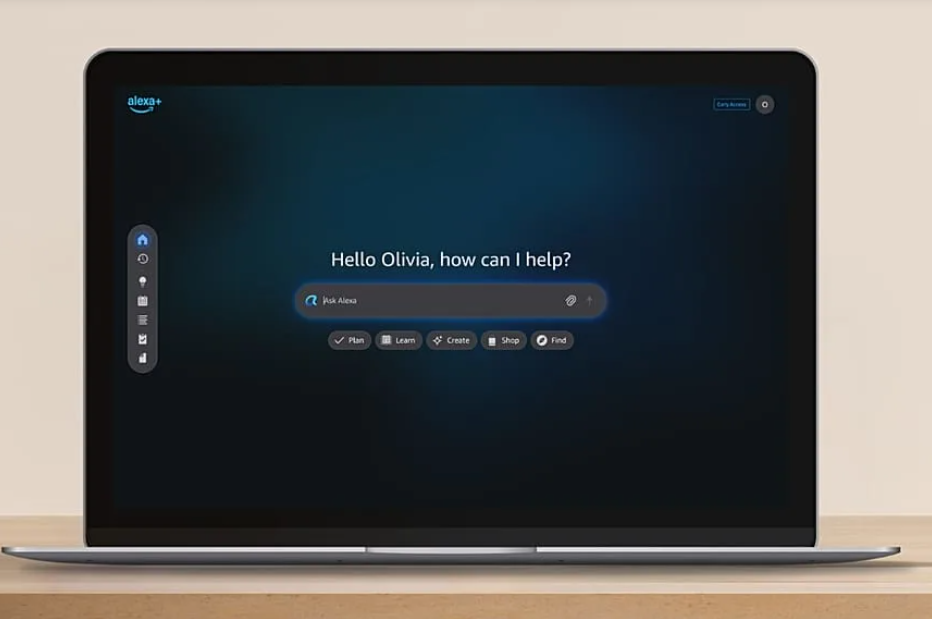

Esta nueva capacidad permite preguntarle a la IA cosas como “¿Hay un restaurante económico con opciones veganas en mi ruta, a menos de tres millas? ¿Cómo funciona el estacionamiento ahí?”, inaugurando un formato conversacional que facilita varias preguntas en una sola interacción.

Además, los conductores pueden reportar incidentes de tráfico mientras avanzan, y Maps —potenciado por Gemini— les avisará proactivamente sobre cortes, demoras y desvíos en el camino que tienen por delante. Esta función de alertas comenzará a desplegarse en EE.UU. para usuarios de Android.

Otro avance relevante reside en la navegación mejorada mediante Gemini y la base de datos de Street View: en vez de la clásica indicación de “girar a la derecha en 500 metros”, ahora la app menciona puntos de referencia cercanos —como estaciones de servicio, restaurantes o edificios conocidos— que aparecen destacados antes del desvío requerido. Según Google, Gemini cruza información de unos 250 millones de lugares con las imágenes de Street View para identificar los puntos más útiles y visibles en cada trayecto, promoviendo una guía mucho más natural y efectiva.

La integración con Google Lens también evoluciona: ahora, al apuntar la cámara hacia un restaurante, monumento o comercio, se pueden realizar preguntas como “¿Qué lugar es este y por qué es popular?”, obteniendo respuestas conscientes del contexto visual gracias al trabajo conjunto entre Lens y Gemini.

La empresa señaló que estas nuevas funciones se desplegarán progresivamente en las próximas semanas en dispositivos iOS y Android. Por ahora, el sistema de navegación con puntos de referencia y las funciones colaborativas con Lens estarán disponibles solo en EE.UU., mientras que la llegada de Gemini para Android Auto se encuentra en la etapa final de desarrollo.

El protagonismo de Google y su modelo Gemini en la app de mapas plantea un futuro donde la información personalizada y la interacción en tiempo real son el estándar. Así, conducir por la ciudad deja de ser solo moverse de un punto A a un punto B, para convertirse en una experiencia guiada, inteligente y adaptada a las necesidades de cada usuario.