La Eurocámara desactiva herramientas como Claude, Copilot y ChatGPT en los equipos de sus legisladores ante temores de filtración de datos y acceso de autoridades estadounidenses. La decisión reabre el debate sobre soberanía digital, protección de datos y la dependencia europea de gigantes tecnológicos de EE.UU.

El Parlamento Europeo decidió bloquear el uso de herramientas de inteligencia artificial integradas en los dispositivos oficiales de sus legisladores, citando riesgos de ciberseguridad y privacidad vinculados a la carga de correspondencia confidencial en servidores en la nube.

Según un correo interno al que tuvo acceso Politico, el departamento de TI de la institución señaló que no puede garantizar la seguridad de los datos que se suben a los servidores de compañías de IA y que el alcance total de la información compartida con estas empresas “todavía está siendo evaluado”. En consecuencia, el mensaje concluye que “se considera más seguro mantener dichas funciones deshabilitadas”.

La medida afecta el uso en dispositivos laborales de chatbots ampliamente adoptados en el sector corporativo y gubernamental, como Anthropic Claude, Microsoft Copilot y OpenAI ChatGPT.

El factor Estados Unidos

Uno de los ejes de preocupación es que muchas de estas plataformas operan bajo jurisdicción estadounidense. Subir datos a estos servicios implica que autoridades de Estados Unidos podrían exigir a las compañías que entreguen información sobre sus usuarios.

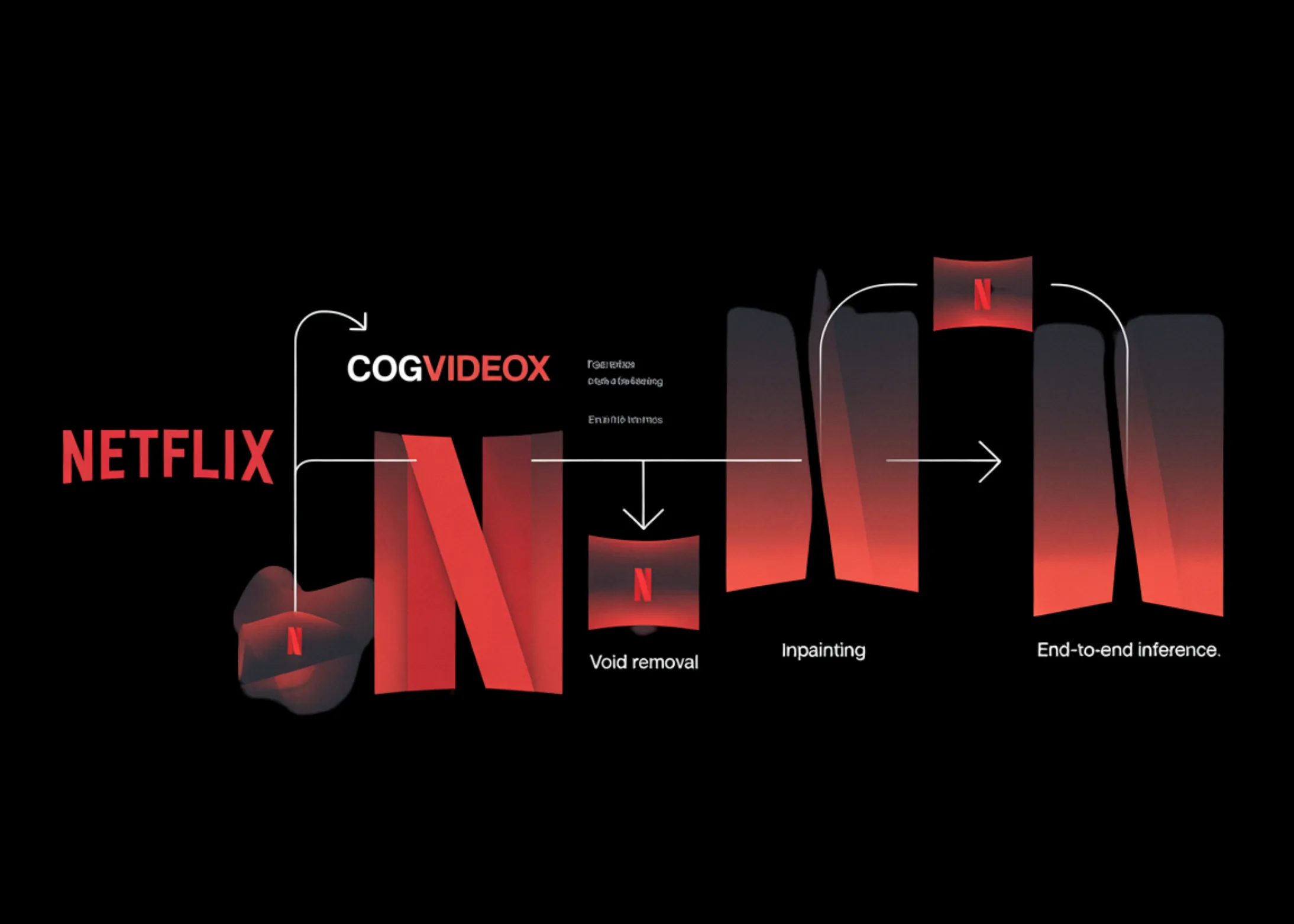

Además, los chatbots suelen utilizar la información proporcionada por los usuarios para mejorar sus modelos, lo que incrementa el riesgo de que datos potencialmente sensibles cargados por una persona puedan, en ciertos contextos, influir en respuestas generadas para otros usuarios.

La decisión del Parlamento se produce en un momento particularmente sensible en la relación transatlántica tecnológica. En las últimas semanas, el Departamento de Seguridad Nacional de Estados Unidos envió cientos de citaciones administrativas a empresas tecnológicas y redes sociales estadounidenses solicitando información sobre personas —incluidos ciudadanos estadounidenses— que habían criticado públicamente políticas de la administración Trump.

Compañías como Google, Meta y Reddit cumplieron en varios casos, aun cuando las citaciones no habían sido emitidas por un juez ni ejecutadas por un tribunal.

Europa y la tensión regulatoria

Europa cuenta con algunas de las normas de protección de datos más estrictas del mundo. Sin embargo, el año pasado la Comisión Europea —órgano ejecutivo del bloque de 27 Estados miembros— presentó propuestas legislativas para flexibilizar ciertas reglas de protección de datos con el objetivo de facilitar que grandes tecnológicas entrenen modelos de IA con datos de ciudadanos europeos.

La iniciativa generó críticas de quienes sostienen que esas modificaciones implican ceder ante las presiones de gigantes tecnológicos estadounidenses.

En este contexto, la decisión de la Eurocámara de restringir el acceso a herramientas de IA en dispositivos oficiales puede leerse como un movimiento defensivo en materia de soberanía digital. También refleja una tendencia más amplia en varios países miembros de la Unión Europea, que están reevaluando su relación con proveedores tecnológicos estadounidenses, especialmente en áreas estratégicas como inteligencia artificial, almacenamiento en la nube y procesamiento de datos sensibles.

Impacto en la adopción institucional de IA

Más allá del caso puntual, la medida pone de relieve una tensión estructural: mientras gobiernos y empresas buscan integrar IA para mejorar productividad y eficiencia, los riesgos asociados al almacenamiento de información en infraestructuras extranjeras se convierten en una barrera crítica.

Para compañías como OpenAI, Anthropic y Microsoft, que han impulsado agresivamente la adopción de sus herramientas en entornos corporativos y gubernamentales, decisiones como la del Parlamento Europeo subrayan que el debate sobre seguridad, jurisdicción y control de datos puede ser tan determinante como la capacidad técnica de los modelos.

En una era donde la inteligencia artificial es vista como infraestructura estratégica, la pregunta ya no es solo qué modelo es más potente, sino bajo qué marco legal y político operan sus servidores. Y en ese terreno, Europa parece dispuesta a priorizar la cautela sobre la velocidad de adopción