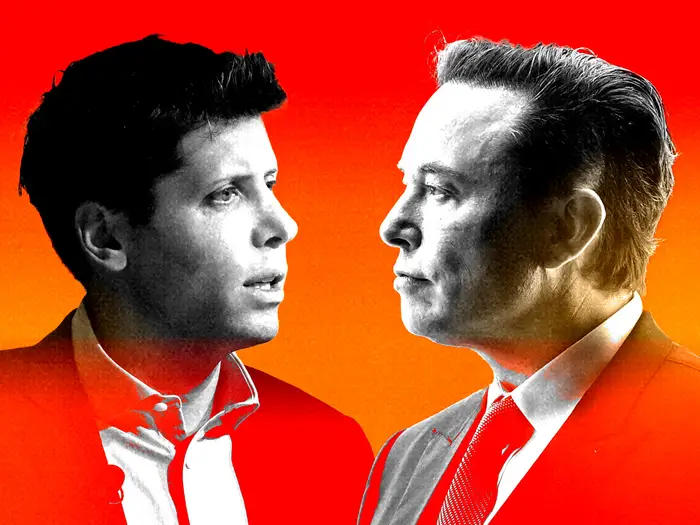

En una declaración judicial explosiva, Elon Musk atacó la seguridad de ChatGPT y defendió a xAI. El caso abre una batalla legal, tecnológica y filosófica sobre el futuro de la inteligencia artificial, la AGI y el modelo de negocio que dominará la industria.

La disputa entre los grandes protagonistas de la inteligencia artificial global dejó definitivamente el terreno tecnológico para instalarse en los tribunales. Una nueva declaración judicial del empresario Elon Musk volvió a encender la confrontación pública con OpenAI, cuestionando directamente la seguridad de sus sistemas y el rumbo comercial de la compañía.

En una deposición recientemente divulgada dentro de la demanda que Musk mantiene contra OpenAI, el fundador de xAI afirmó que su empresa prioriza mejor la seguridad que su rival.

“Nadie se ha suicidado por Grok, pero aparentemente sí lo han hecho por ChatGPT”, sostuvo Musk durante el interrogatorio judicial.

La frase, una de las más controvertidas del proceso, aparece en un contexto donde OpenAI enfrenta múltiples demandas que alegan que interacciones manipulativas con ChatGPT habrían provocado efectos negativos en la salud mental de algunos usuarios, incluyendo casos que terminaron en suicidio.

El origen del conflicto: del idealismo al negocio

El núcleo del litigio gira en torno a la transformación de OpenAI desde un laboratorio sin fines de lucro hacia una estructura comercial con fines de lucro. Musk sostiene que ese cambio violó los acuerdos fundacionales de la organización.

Según su argumentación, la presión por crecimiento, escala y generación de ingresos podría colocar los incentivos económicos por encima de la seguridad tecnológica.

El empresario vinculó esta preocupación con una carta abierta firmada en marzo de 2023 por más de 1.100 expertos y referentes del sector, donde se pedía una pausa de al menos seis meses en el desarrollo de sistemas más avanzados que GPT-4.

El documento advertía que los laboratorios estaban inmersos en una “carrera fuera de control para desarrollar mentes digitales cada vez más poderosas que nadie —ni siquiera sus creadores— puede comprender, predecir o controlar de manera confiable”.

Durante la declaración, Musk explicó: “La firmé, como muchos otros, para pedir cautela en el desarrollo de la IA. Solo quería que la seguridad fuera prioritaria”.

AGI, riesgos y una corrección millonaria

El testimonio también abordó el concepto de inteligencia artificial general (AGI), la hipotética tecnología capaz de igualar o superar la capacidad cognitiva humana en múltiples tareas.

Musk fue directo: “Tiene un riesgo”.

Además, corrigió una afirmación previa sobre su aporte financiero inicial a OpenAI. Aunque durante años se mencionó una donación cercana a U$S 100 millones, la demanda enmendada sitúa el monto real en aproximadamente U$S 44,8 millones.

El empresario también explicó el origen de OpenAI desde su perspectiva personal: el temor a que Google se convirtiera en un monopolio de inteligencia artificial.

Recordó conversaciones con el cofundador de Google, Larry Page, que calificó como “alarmantes” porque, según él, Page “no parecía tomarse en serio la seguridad de la IA”.

Un argumento que también golpea a xAI

Sin embargo, el debate sobre seguridad no afecta solo a OpenAI. Desde la grabación del testimonio, la propia xAI enfrentó cuestionamientos regulatorios.

El mes pasado, la red social X (social media platform), también propiedad de Musk, fue inundada con imágenes desnudas generadas sin consentimiento por el modelo Grok, algunas presuntamente de menores.

El episodio provocó investigaciones oficiales del fiscal general de California y procesos regulatorios en la Unión Europea, además de bloqueos y restricciones en distintos países.

El contraste evidencia una tensión central del momento actual de la industria: ninguna compañía de IA logra escapar completamente de los riesgos que denuncia.

La verdadera batalla: quién define la seguridad de la IA

Más allá del caso judicial, el enfrentamiento Musk-OpenAI refleja un debate más profundo sobre el futuro del sector.

¿Debe la inteligencia artificial desarrollarse bajo estructuras abiertas y sin fines de lucro?

¿O el capital privado y la velocidad comercial son inevitables para competir globalmente?

La disputa también expone cómo la seguridad pasó de ser un concepto académico a convertirse en un arma competitiva y legal entre empresas.

Mientras OpenAI avanza con alianzas gubernamentales y despliegues estratégicos, Musk intenta posicionar a xAI como el actor que representa la “IA segura”. Pero las investigaciones regulatorias demuestran que el problema excede a cualquier empresa individual.

La carrera hacia la AGI ya no es solo tecnológica. Es jurídica, política y reputacional.

Y el juicio que comenzará el próximo mes podría convertirse en uno de los procesos más influyentes en la historia de la inteligencia artificial moderna.