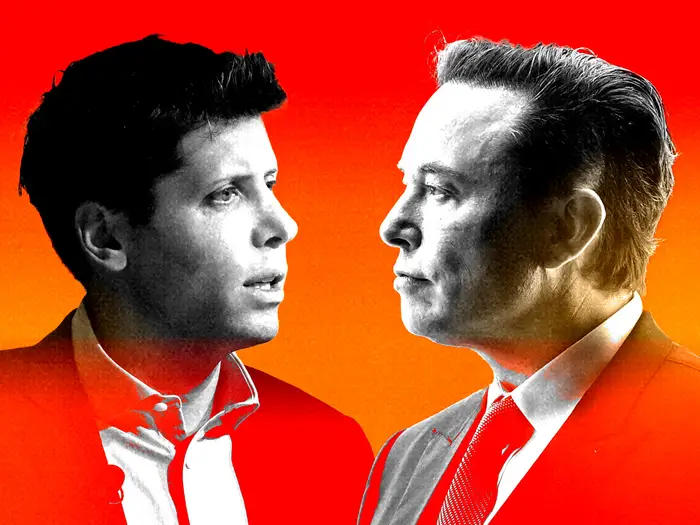

Tras la ruptura entre el gobierno de EE.UU. y Anthropic, OpenAI selló un acuerdo urgente con el Pentágono para operar IA en entornos clasificados. Sam Altman admite que fue “apresurado”, mientras crece el debate global sobre vigilancia, armas autónomas y control tecnológico.

La inteligencia artificial entró oficialmente en una nueva fase geopolítica. Y esta vez no se trata de modelos más potentes ni de nuevos productos comerciales, sino del vínculo directo entre los grandes laboratorios de IA y la seguridad nacional estadounidense.

La startup OpenAI reveló nuevos detalles sobre su reciente acuerdo con el Departamento de Defensa de Estados Unidos, firmado apenas días después de que el gobierno decidiera abandonar la tecnología de su rival Anthropic.

El propio CEO Sam Altman reconoció públicamente que el proceso fue acelerado. “Definitivamente fue apresurado, y la percepción pública no se ve bien”, admitió al referirse al convenio alcanzado con el Pentágono.

Un cambio político que reordenó el mapa de la IA

El acuerdo no ocurrió en un vacío corporativo. Luego del fracaso de las negociaciones entre Anthropic y el Pentágono, el presidente Donald Trump ordenó a las agencias federales abandonar progresivamente la tecnología de Anthropic en un plazo de seis meses.

El secretario de Defensa Pete Hegseth incluso calificó a la compañía como un “riesgo para la cadena de suministro”, acelerando el reemplazo tecnológico dentro del gobierno.

En ese contexto, OpenAI anunció rápidamente un acuerdo para desplegar sus modelos dentro de entornos clasificados del Departamento de Defensa.

La pregunta inmediata fue inevitable: si ambas compañías afirmaban tener límites éticos similares, ¿por qué OpenAI logró cerrar el contrato mientras Anthropic no?

Las “líneas rojas” de OpenAI

Para responder a las críticas, OpenAI publicó un documento detallando tres usos explícitamente prohibidos para sus sistemas de IA:

- vigilancia doméstica masiva,

- sistemas de armas autónomas,

- decisiones automatizadas de alto riesgo, como modelos tipo “crédito social”.

Según la empresa, su enfoque de seguridad no depende solo de cláusulas contractuales.

“Conservamos plena discreción sobre nuestra arquitectura de seguridad, desplegamos mediante la nube, personal autorizado de OpenAI permanece en el circuito y contamos con fuertes protecciones contractuales”, explicó la compañía en su blog oficial.

Además, agregó: “No sabemos por qué Anthropic no pudo alcanzar este acuerdo y esperamos que más laboratorios lo consideren”.

El debate sobre vigilancia no se detiene

Las aclaraciones no frenaron las críticas. El analista Mike Masnick sostuvo que el contrato “sí permite vigilancia doméstica”, señalando que el acuerdo contempla el cumplimiento de la Orden Ejecutiva 12333, normativa vinculada históricamente a operaciones de inteligencia estadounidenses.

Desde OpenAI respondieron que el foco está mal planteado.

La responsable de alianzas de seguridad nacional, Katrina Mulligan, afirmó que muchos debates asumen erróneamente que una cláusula contractual es la única barrera contra abusos tecnológicos.

“Así no funciona esto”, escribió. “La arquitectura de despliegue importa más que el lenguaje contractual […] Al limitar el uso a APIs en la nube, garantizamos que nuestros modelos no puedan integrarse directamente en armas, sensores u otros sistemas operativos”.

Una apuesta para desescalar la tensión entre gobierno e industria

Altman también respondió preguntas públicas sobre el acuerdo y reconoció que generó un fuerte costo reputacional para la empresa. El impacto fue inmediato: el chatbot Claude de Anthropic llegó a superar temporalmente a ChatGPT en el ranking de la App Store de Apple tras la controversia.

¿Por qué avanzar entonces?

“Realmente queríamos desescalar la situación y pensamos que el acuerdo ofrecido era bueno”, explicó Altman. “Si esto logra una desescalada entre el Departamento de Defensa y la industria, pareceremos genios. Si no, seguiremos siendo vistos como apresurados y descuidados”.

La nueva guerra fría de la inteligencia artificial

El episodio marca un punto de inflexión para el sector tecnológico global. Por primera vez, las decisiones sobre qué modelo de IA utiliza el gobierno estadounidense no dependen solo de capacidad técnica, sino de alineamiento político, gobernanza ética y arquitectura de control.

La inteligencia artificial dejó de ser únicamente una carrera comercial entre startups y gigantes tecnológicos. Ahora es parte explícita de la infraestructura estratégica de seguridad nacional.

Y en ese tablero emergente, el acuerdo entre OpenAI y el Pentágono confirma algo que la industria empieza a asumir: la próxima competencia por la supremacía en IA no se jugará solo en Silicon Valley, sino también en Washington.