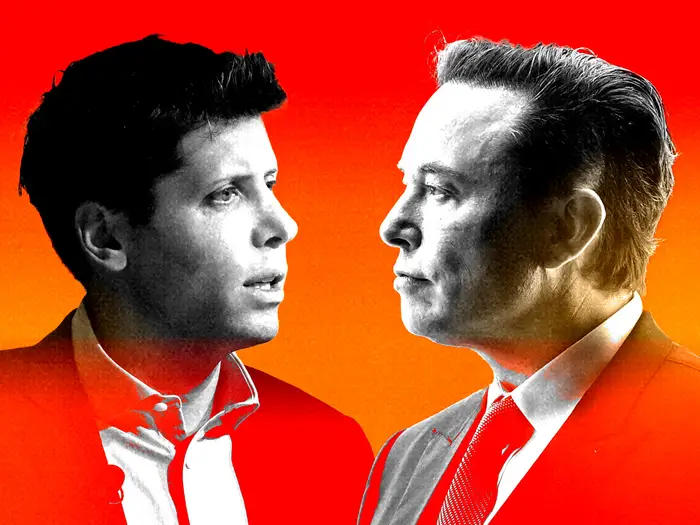

El CEO de Anthropic criticó duramente el acuerdo entre OpenAI y el Departamento de Defensa de Estados Unidos. Dario Amodei lo calificó como “teatro de seguridad” y acusó a Sam Altman de difundir “mentiras directas” sobre los límites del uso militar de la inteligencia artificial.

La carrera global por liderar el desarrollo de inteligencia artificial no solo enfrenta a las principales empresas tecnológicas en el terreno comercial y científico. También abre tensiones cada vez más visibles sobre el uso militar de estas tecnologías.

En ese contexto, el CEO y cofundador de Anthropic, Dario Amodei, lanzó una dura crítica contra OpenAI y su director ejecutivo, Sam Altman, tras el acuerdo firmado entre la empresa creadora de ChatGPT y el Departamento de Defensa de Estados Unidos (DoD).

Según reveló un memorando interno citado por el medio especializado The Information, Amodei calificó la estrategia comunicacional de OpenAI como “teatro de seguridad” y aseguró que las declaraciones públicas de Altman sobre el contrato militar contienen “mentiras directas”.

“La principal razón por la que OpenAI aceptó el acuerdo con el Departamento de Defensa y nosotros no es que ellos se preocuparon por tranquilizar a sus empleados, mientras que nosotros realmente nos preocupamos por prevenir abusos”, escribió Amodei en una comunicación dirigida al personal de Anthropic.

El contrato militar que desató la disputa

El conflicto se originó luego de que Anthropic y el Departamento de Defensa no lograran llegar a un acuerdo sobre el acceso del ejército estadounidense a la tecnología de inteligencia artificial de la compañía.

Anthropic ya mantenía previamente un contrato de U$S 200 millones con el ejército estadounidense, pero en las negociaciones más recientes la empresa insistió en incluir garantías explícitas que limitaran el uso de su IA en determinados escenarios.

En particular, la compañía exigía que el Pentágono confirmara que su tecnología no sería utilizada para habilitar vigilancia masiva doméstica ni para desarrollar armamento autónomo.

La propuesta no prosperó. Tras el fracaso de esas negociaciones, el Departamento de Defensa decidió avanzar con OpenAI, que firmó un acuerdo alternativo para el uso de sus sistemas de inteligencia artificial.

Sam Altman defendió públicamente el contrato asegurando que el acuerdo con el gobierno estadounidense incluye las mismas restricciones que Anthropic pretendía imponer.

Sin embargo, Amodei sostiene que esa afirmación es incorrecta.

En su carta al personal, el CEO de Anthropic afirmó que Altman “se está presentando falsamente como un pacificador y negociador”, y calificó esa narrativa como “mentiras directas”.

El punto clave: “uso legal”

El desacuerdo central gira en torno a una frase aparentemente técnica pero con implicancias profundas: el concepto de “uso legal”.

Anthropic objetó que el Departamento de Defensa exigiera acceso a su inteligencia artificial para “cualquier uso legal”.

OpenAI, por su parte, confirmó en una publicación oficial que su contrato con el gobierno estadounidense permite utilizar sus sistemas de IA para “todos los propósitos legales”.

En su blog, la empresa sostuvo que esa redacción no abre la puerta a usos problemáticos.

“Quedó claro en nuestras interacciones que el Departamento de Guerra considera ilegal la vigilancia masiva doméstica y no tenía previsto utilizar la tecnología para ese propósito”, señaló OpenAI.

La compañía también aseguró que “nos aseguramos de que el hecho de que esto no esté cubierto dentro del uso legal quede explícito en nuestro contrato”.

Sin embargo, críticos del acuerdo señalan que lo que hoy es ilegal podría dejar de serlo en el futuro, lo que abre interrogantes sobre el alcance real de esa cláusula.

Impacto público y tensiones en la industria

El debate no quedó limitado a las empresas involucradas. Según datos citados en el informe, las desinstalaciones de ChatGPT aumentaron un 295% después de que se hiciera público el acuerdo entre OpenAI y el Departamento de Defensa.

Ese cambio en la percepción pública parece haber sido observado de cerca por Anthropic.

En su mensaje interno, Amodei escribió:

“Creo que este intento de manipulación o gaslighting no está funcionando muy bien ni con el público ni con los medios, donde la mayoría ve el acuerdo de OpenAI con el Departamento de Guerra como algo sospechoso, y nos ve a nosotros como los héroes”.

El CEO incluso destacó que la aplicación de Anthropic alcanzó el puesto número 2 en la App Store, un indicador que, según él, refleja el apoyo del público a la postura de su empresa.

Amodei agregó con ironía que la narrativa de OpenAI “sí está funcionando con algunos idiotas de Twitter, lo cual no importa”, pero expresó preocupación por “asegurarse de que no funcione con los empleados de OpenAI”.

Una disputa que refleja un debate mayor

Más allá de las acusaciones cruzadas entre Anthropic y OpenAI, el episodio refleja un debate creciente en la industria tecnológica: qué papel deberían jugar las empresas de inteligencia artificial en el ámbito militar y de seguridad nacional.

A medida que los modelos de IA se vuelven más poderosos y versátiles, gobiernos de todo el mundo buscan integrarlos en sistemas de defensa, inteligencia y análisis estratégico.

Para compañías como Anthropic, ese avance exige establecer límites claros desde el inicio.

Para otras, como OpenAI, el foco parece estar en permitir la colaboración con gobiernos bajo el marco legal vigente.

La discusión, sin embargo, recién empieza. Y todo indica que la competencia por dominar la inteligencia artificial global también se librará en el terreno de la ética, la regulación y la seguridad internacional.