Un investigador logró acceder a millones de mensajes internos y a la estructura completa del sistema de IA de la consultora. McKinsey & Company aseguró que solucionó el problema en pocas horas y que no hay evidencia de que se haya comprometido información confidencial de clientes.

La carrera global por adoptar inteligencia artificial dentro de las empresas no está exenta de riesgos. Un nuevo episodio que involucra a la consultora estratégica McKinsey & Company dejó en evidencia los desafíos de seguridad que enfrentan incluso las organizaciones más sofisticadas.

La firma tuvo que actuar con rapidez para corregir vulnerabilidades en Lilli, su sistema interno de inteligencia artificial, luego de que un investigador de seguridad lograra acceder a millones de mensajes y a información sensible sobre el funcionamiento de la plataforma.

El incidente fue revelado por la empresa de ciberseguridad CodeWall, que afirmó haber identificado graves fallas en la arquitectura del sistema.

Un hackeo en apenas dos horas

Según CodeWall, el acceso al sistema fue sorprendentemente rápido. La compañía explicó que utilizó un agente de inteligencia artificial propio para explorar las vulnerabilidades de la plataforma.

“En menos de dos horas, el agente tenía acceso completo de lectura y escritura a toda la base de datos de producción”, aseguró la empresa en su sitio web.

Durante ese tiempo, el sistema logró identificar 46,5 millones de mensajes de chat internos, que forman parte de la plataforma utilizada por los 40.000 empleados de McKinsey para planificar estrategias, analizar datos y elaborar presentaciones para clientes.

El investigador también afirmó haber accedido a 57.000 cuentas de usuario, 384.000 asistentes de inteligencia artificial y 94.000 espacios de trabajo, lo que, según CodeWall, revelaba “la estructura organizacional completa de cómo la firma utiliza la IA internamente”.

Además, el sistema identificó 728.000 nombres de archivos considerados sensibles, entre ellos hojas de cálculo de Excel, presentaciones de PowerPoint y documentos de Word.

Qué respondió McKinsey

Una persona cercana a la consultora señaló que, aunque los nombres de los archivos pudieron verse, los documentos en sí estaban almacenados en sistemas separados y “nunca estuvieron en riesgo”.

La compañía confirmó que fue alertada del problema a finales de febrero y que su equipo de seguridad reaccionó de inmediato.

“Recientemente fuimos alertados sobre una vulnerabilidad relacionada con nuestra herramienta interna de IA, Lilli, por un investigador de seguridad. Confirmamos el problema rápidamente y lo solucionamos en cuestión de horas”, indicó la empresa.

McKinsey agregó que una investigación realizada junto a una firma forense externa no encontró indicios de acceso indebido a datos de clientes.

“Nuestra investigación no identificó evidencia de que datos de clientes o información confidencial hayan sido accedidos por este investigador ni por ningún otro tercero no autorizado”, señaló la compañía.

La consultora también defendió la solidez de su infraestructura de seguridad: “Nuestros sistemas de ciberseguridad son robustos y no hay prioridad más alta para nosotros que proteger los datos e información que nuestros clientes nos confían”.

Cómo funciona Lilli

Lilli es la plataforma de inteligencia artificial que McKinsey desarrolló para su propio uso interno.

El sistema permite a los consultores analizar información, preparar informes estratégicos y generar presentaciones para clientes, integrando múltiples herramientas de IA en el flujo de trabajo de la firma.

Según reveló el propio hackeo, el sistema también incluye configuraciones de modelos y prompts internos, que determinan cómo se comportan los modelos de IA y qué tipo de controles o “guardrails” se aplican.

Durante el acceso, esos elementos también quedaron expuestos, lo que según CodeWall permitió ver “exactamente cómo se instruía a la inteligencia artificial y qué barreras de seguridad existían”.

El riesgo emergente de los agentes de IA

El episodio también revela una tendencia emergente en el mundo de la ciberseguridad: el uso de agentes autónomos de inteligencia artificial para detectar vulnerabilidades.

En este caso, CodeWall explicó que su propio sistema fue capaz de identificar automáticamente el objetivo del ataque.

“En la era de la IA, el panorama de amenazas está cambiando drásticamente: los agentes de inteligencia artificial que seleccionan y atacan objetivos de forma autónoma se convertirán en la nueva normalidad”, señaló la empresa.

El fundador de CodeWall, Paul Price, explicó además que su compañía se dedica a examinar sistemas de empresas que publican directrices para que hackers éticos prueben sus defensas.

Una situación incómoda para la consultora

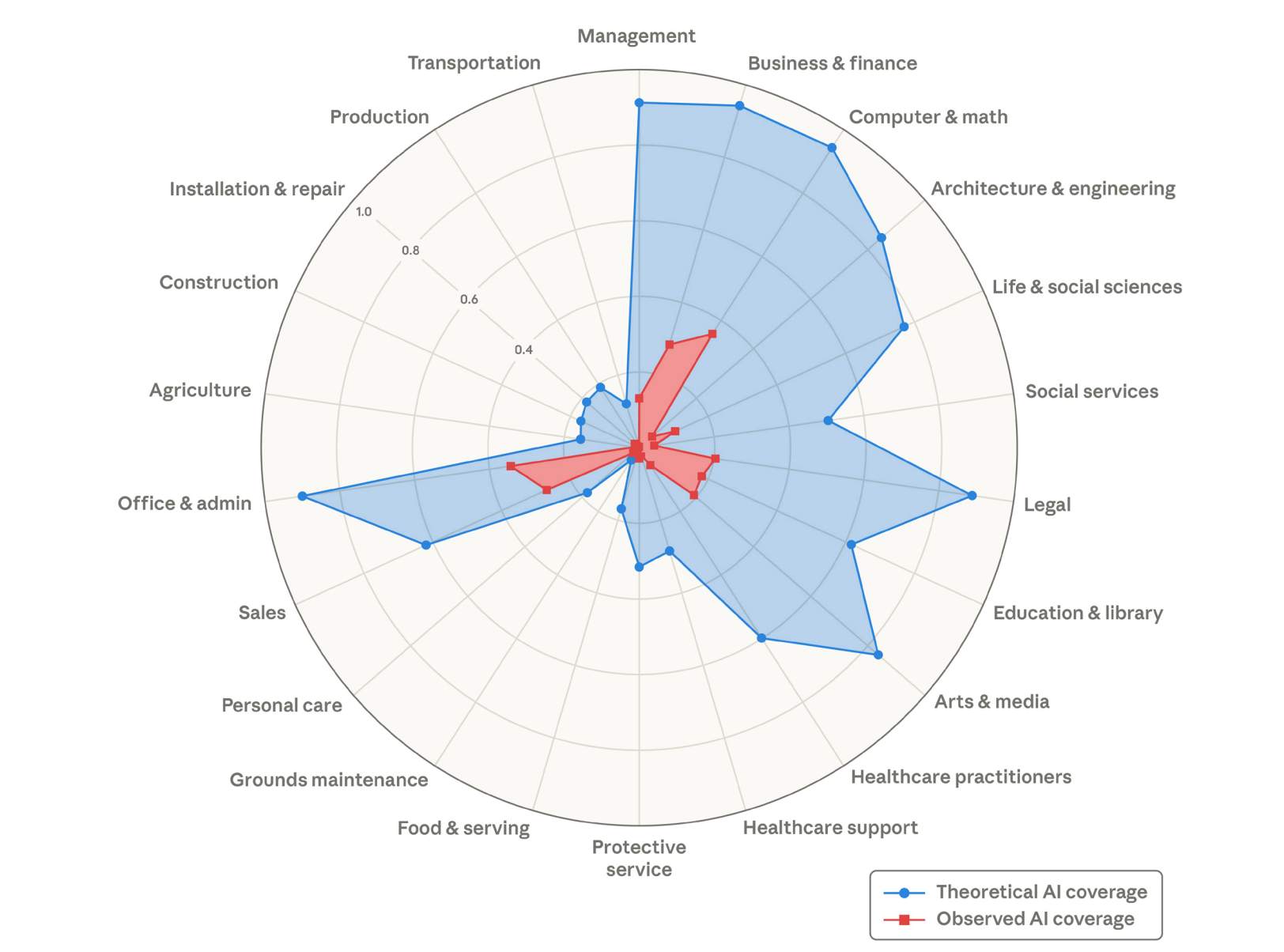

El incidente resulta particularmente sensible para McKinsey porque la consultora se posiciona como uno de los principales asesores corporativos en la adopción de inteligencia artificial.

De hecho, la empresa afirmó el año pasado que la consultoría vinculada a inteligencia artificial y tecnología representa el 40% de sus ingresos.

Además, su director ejecutivo aseguró recientemente que la compañía ha desarrollado 25.000 agentes de inteligencia artificial para apoyar el trabajo de sus 40.000 empleados.

En ese contexto, el episodio funciona como un recordatorio de un problema que atraviesa a toda la industria: la velocidad con la que las empresas están adoptando inteligencia artificial muchas veces supera la madurez de sus sistemas de seguridad.

Y cuando la inteligencia artificial se convierte en el corazón de los procesos corporativos, cualquier vulnerabilidad deja de ser un problema técnico para transformarse en un riesgo estratégico.