Un error humano dejó al descubierto más de 512.000 líneas de código del asistente de programación de Anthropic. Aunque no hubo datos de clientes comprometidos, el incidente ya genera riesgos de ciberseguridad y revela detalles clave de su tecnología.

Un error técnico con impacto estratégico. Anthropic confirmó la filtración de parte del código fuente de Claude Code, su asistente de programación basado en inteligencia artificial, tras un fallo en el empaquetado de una versión publicada en npm.

Claro, esto sucedió justo después de su enfrentamiento público con el Gobierno de EE.UU.

El incidente ocurrió con la versión 2.1.88 del paquete, que incluyó accidentalmente un archivo “source map” que permitía acceder al código interno de la herramienta. En total, se expusieron cerca de 2.000 archivos en TypeScript y más de 512.000 líneas de código. La versión ya fue retirada de la plataforma.

Desde la compañía buscaron llevar calma. “No hubo exposición de datos sensibles de clientes ni credenciales. Se trató de un problema de empaquetado causado por un error humano, no de una brecha de seguridad”, señalaron en un comunicado.

De error técnico a exposición global

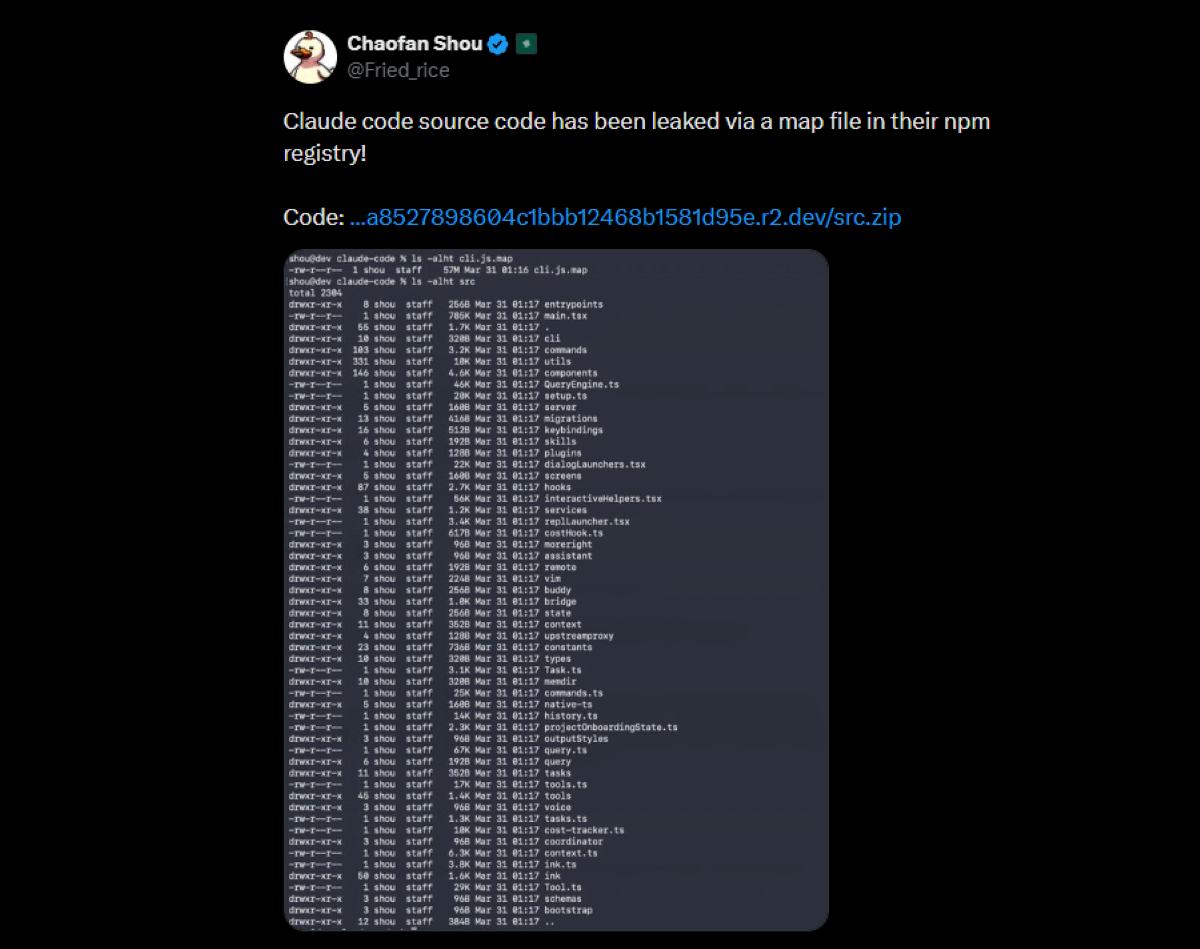

La filtración fue detectada inicialmente por el investigador de seguridad Chaofan Shou, quien publicó el hallazgo en X, donde el mensaje superó los 28,8 millones de visualizaciones.

A partir de allí, el código comenzó a circular rápidamente. Un repositorio público en GitHub que replica el contenido filtrado ya supera las 84.000 estrellas y 82.000 forks, evidenciando el nivel de interés —y preocupación— en la comunidad tecnológica.

Radiografía interna de Claude Code

Más allá del incidente, la filtración dejó al descubierto la arquitectura interna de Claude Code, ofreciendo una visión inédita de cómo funciona uno de los asistentes de programación más avanzados del mercado.

Entre los componentes revelados se destacan:

- Un sistema de herramientas que permite ejecutar acciones como lectura de archivos o comandos bash

- Un motor de consultas para orquestar llamadas a modelos de lenguaje

- Un sistema de multiagentes capaz de desplegar “sub-agentes” para tareas complejas

- Una capa de comunicación bidireccional entre extensiones de IDE y la interfaz CLI

Uno de los elementos más llamativos es KAIROS, una funcionalidad que permite a Claude operar como un agente persistente en segundo plano, capaz de ejecutar tareas, corregir errores y enviar notificaciones sin intervención humana.

A esto se suma un modo experimental denominado “dream”, diseñado para que el sistema “piense” continuamente en segundo plano, generando y refinando ideas de manera autónoma.

Modo encubierto y defensa contra competidores

La filtración también reveló funciones más sensibles desde el punto de vista estratégico. Entre ellas, un “Undercover Mode” que permite a la IA realizar contribuciones en repositorios open source sin revelar su origen.

El sistema indica explícitamente: “Estás operando de forma encubierta en un repositorio público. Tus mensajes de commit y PR no deben contener ninguna información interna de Anthropic”.

Otro hallazgo relevante es un mecanismo para combatir ataques de distilación de modelos. Claude Code puede inyectar definiciones falsas en sus respuestas para contaminar los datos de entrenamiento de posibles competidores que intenten replicar su funcionamiento.

Riesgos de seguridad y efecto dominó

El principal riesgo inmediato no es la filtración en sí, sino sus consecuencias. Empresas de ciberseguridad como Straiker advirtieron que el acceso al código permite a atacantes diseñar ataques más sofisticados.

“En lugar de forzar ataques tradicionales, los actores maliciosos ahora pueden estudiar cómo fluye la información en el sistema y diseñar cargas que persistan en sesiones largas”, señalaron.

Además, el incidente se vio agravado por un ataque a la cadena de suministro: usuarios que instalaron el paquete en una ventana específica del 31 de marzo podrían haber descargado una versión comprometida con un troyano de acceso remoto multiplataforma.

Ataques en curso y nuevo frente de riesgo

Tras la filtración, ya se detectaron intentos de explotación. Atacantes comenzaron a registrar paquetes falsos en npm utilizando nombres similares a dependencias internas de Claude Code, en una técnica conocida como “typosquatting”.

El investigador Clément Dumas advirtió: “Por ahora son paquetes vacíos, pero así funcionan estos ataques: ocupan el nombre, esperan descargas y luego introducen código malicioso”.

Un golpe en un momento clave

El incidente llega en un momento delicado para Anthropic. Días antes, la compañía había expuesto involuntariamente información sobre su próximo modelo de IA a través de su sistema de gestión de contenidos.

Según trascendió, ese nuevo modelo —aún en pruebas con clientes— sería “el más capaz que hemos construido hasta la fecha”.

En conjunto, ambos episodios ponen el foco en un desafío crítico para la industria: a medida que los modelos de inteligencia artificial se vuelven más complejos y estratégicos, también aumentan los riesgos operativos y de seguridad.

Para Anthropic, el costo inmediato puede ser reputacional. Pero el impacto real podría ser más profundo: en un mercado donde el diferencial competitivo está en la arquitectura, perder el control del código es, también, perder parte de la ventaja.