Un error interno dejó al descubierto detalles de Claude Mythos, el modelo más avanzado de Anthropic. La compañía confirma que representa un “salto significativo” en capacidades, pero advierte sobre riesgos inéditos en ciberseguridad mientras avanza con un despliegue limitado.

Un error humano terminó revelando lo que Anthropic intentaba mantener en secreto: el desarrollo de su modelo de inteligencia artificial más potente hasta la fecha. Bajo el nombre de Claude Mythos —también referido internamente como “Capybara”—, la compañía confirmó que ya está siendo probado por clientes seleccionados en una fase de acceso anticipado.

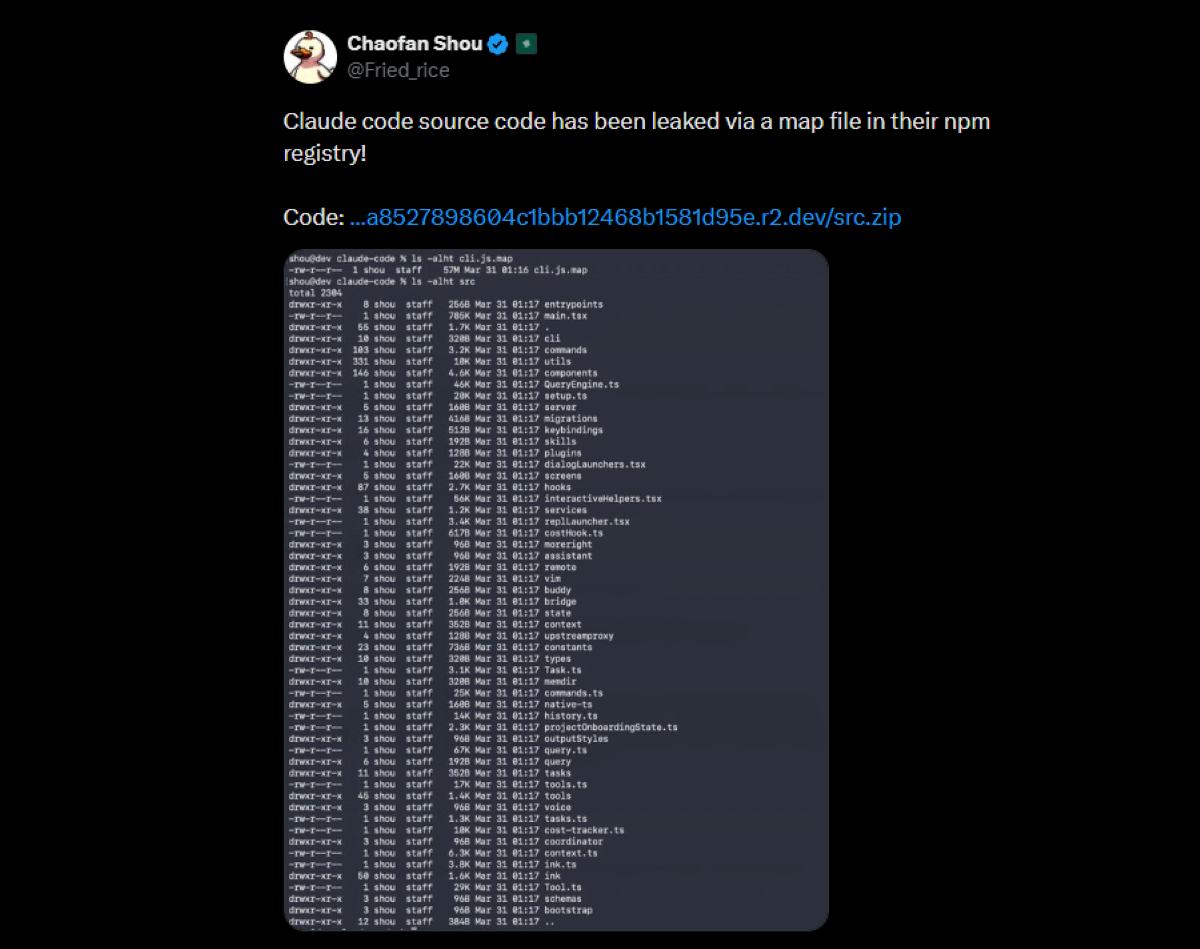

El incidente se originó cuando documentos internos, incluyendo borradores de blog y activos no publicados, quedaron accesibles en un repositorio público. Según investigadores en ciberseguridad, cerca de 3.000 archivos vinculados al blog de la empresa podían ser consultados sin restricciones.

Desde la compañía reconocieron el problema: “Un error humano en la configuración de nuestro sistema de gestión de contenidos permitió que borradores de contenido fueran accesibles”, explicaron, subrayando que se trataba de material preliminar.

Un modelo más allá de Opus

Más allá de la filtración, el dato más relevante es el alcance tecnológico del nuevo modelo. Anthropic lo define como un “salto significativo” (“step change”) en rendimiento, y afirma que es “el modelo más capaz que hemos construido hasta la fecha”.

Actualmente, la empresa organiza sus modelos en tres niveles: Haiku (más rápido y económico), Sonnet (equilibrado) y Opus (el más potente). Sin embargo, el nuevo desarrollo introduce una categoría superior.

Según el documento filtrado, “Capybara es un nuevo nivel de modelo: más grande y más inteligente que nuestros modelos Opus, que hasta ahora eran los más poderosos”. En concreto, comparado con Claude Opus 4.6, el nuevo sistema logra “resultados significativamente superiores en pruebas de programación, razonamiento académico y ciberseguridad”.

Riesgos inéditos en ciberseguridad

El aspecto más sensible del modelo no es solo su potencia, sino sus implicancias. Anthropic advierte que el sistema está “muy por delante de cualquier otro modelo en capacidades de ciberseguridad” y que anticipa una ola de herramientas capaces de explotar vulnerabilidades a una velocidad que podría superar a los sistemas de defensa actuales.

El propio documento señala: “Queremos actuar con extrema cautela y entender los riesgos que plantea, especialmente en ciberseguridad, y compartir esos resultados para ayudar a los defensores”.

Este enfoque refleja una preocupación creciente en la industria: los modelos avanzados tienen un carácter dual. Pueden ser utilizados tanto para fortalecer sistemas como para ejecutar ataques a gran escala.

Anthropic ya había enfrentado situaciones similares. La compañía reveló que grupos de hackers vinculados al gobierno chino intentaron utilizar sus herramientas en ataques reales, incluyendo una campaña que apuntó a alrededor de 30 organizaciones, entre empresas tecnológicas, instituciones financieras y agencias gubernamentales.

Estrategia de lanzamiento: acceso restringido

A diferencia de lanzamientos masivos, Anthropic está optando por un despliegue controlado. El modelo no está listo para el público general y, además, presenta altos costos operativos.

“Estamos desarrollando un modelo de propósito general con avances significativos en razonamiento, programación y ciberseguridad”, indicó un portavoz. “Dada la potencia de sus capacidades, estamos siendo deliberados en cómo lo lanzamos”.

En esta primera etapa, el acceso está limitado a un grupo reducido de clientes, con el objetivo de evaluar riesgos y ajustar el sistema antes de una eventual apertura.

Un movimiento en plena carrera por la IA

El avance de Anthropic se da en un contexto de competencia acelerada con OpenAI, que recientemente clasificó uno de sus modelos como de “alta capacidad” en tareas de ciberseguridad, y otros actores como Google, que continúa expandiendo su familia Gemini.

La carrera ya no se limita a mejorar benchmarks: ahora también implica gestionar riesgos sistémicos.

Más que tecnología: una jugada comercial

La filtración también dejó al descubierto la estrategia comercial de la empresa. Entre los documentos había detalles de un evento exclusivo para CEOs europeos, descrito como un encuentro íntimo en una mansión del siglo XVIII en el Reino Unido, donde se presentarán capacidades aún no lanzadas del sistema.

El evento contará con la presencia de Dario Amodei y apunta a posicionar a la compañía frente a grandes corporaciones en Europa.

El caso de Claude Mythos sintetiza el momento actual de la inteligencia artificial: avances tecnológicos cada vez más rápidos, pero acompañados de riesgos crecientes y decisiones estratégicas cada vez más complejas. En ese equilibrio, empresas como Anthropic empiezan a definir no solo el futuro del negocio, sino también los límites de la tecnología.