La Casa Blanca denuncia campañas masivas de “destilación” de modelos de inteligencia artificial y avanza en compartir inteligencia con OpenAI, Google y Anthropic. El conflicto redefine la competencia tecnológica global y escala a nivel geopolítico.

La competencia global por la inteligencia artificial acaba de entrar en una nueva fase. La Casa Blanca acusó formalmente a China de llevar adelante campañas de “destilación” de modelos de IA a escala industrial, una práctica que —según Washington— permite replicar capacidades avanzadas sin acceder directamente al código o la infraestructura original.

El anuncio fue realizado por la Oficina de Política Científica y Tecnológica (OSTP), dirigida por Michael Kratsios, quien afirmó: “Tenemos evidencia de que entidades extranjeras, principalmente en China, están ejecutando campañas de destilación a escala industrial para robar inteligencia artificial estadounidense. Vamos a tomar medidas para proteger la innovación”.

Qué es la “destilación” y por qué preocupa

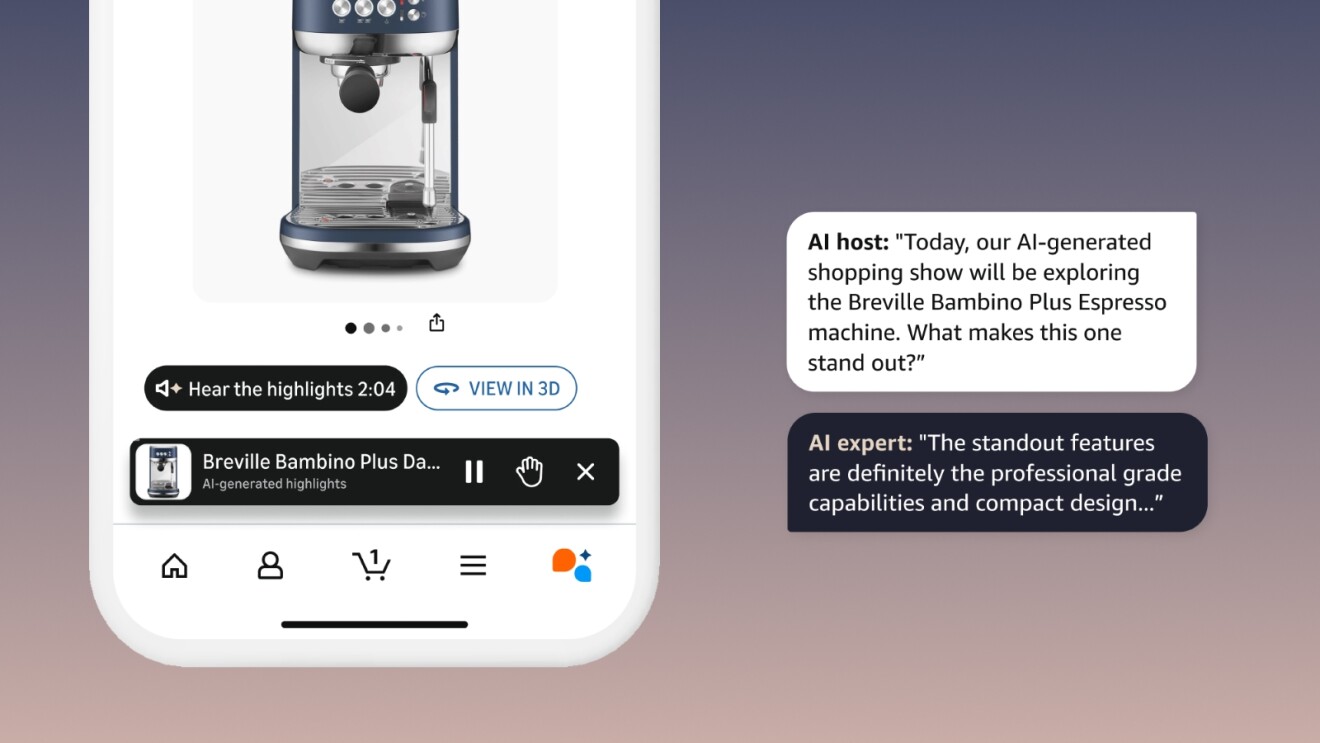

En el centro del conflicto está una técnica conocida como “distillation”. A diferencia de un hackeo tradicional, no implica robar datos ni infiltrarse en servidores. En cambio, consiste en enviar miles o millones de consultas a modelos avanzados, recolectar sus respuestas y utilizarlas para entrenar sistemas más económicos que replican sus capacidades.

En términos simples, es aprender de las respuestas del “profesor” sin acceder directamente a su conocimiento interno.

El problema es que esta práctica se mueve en una zona gris legal. No está claramente cubierta por las leyes actuales de propiedad intelectual, pero sus implicancias estratégicas son enormes: permite a nuevos actores desarrollar modelos competitivos sin incurrir en los costos multimillonarios de entrenamiento.

Las pruebas: acusaciones cruzadas entre gigantes de la IA

El informe de la Casa Blanca se apoya en denuncias previas de empresas líderes del sector. OpenAI, por ejemplo, acusó en febrero a la firma china DeepSeek de utilizar esta técnica para replicar sus modelos.

Según la compañía, identificó cuentas vinculadas a empleados de DeepSeek que habrían eludido restricciones de acceso mediante proxies de terceros para extraer respuestas a gran escala.

Por su parte, Anthropic presentó evidencia aún más detallada. Señaló a tres laboratorios chinos —DeepSeek, MiniMax y Moonshot AI— como responsables de más de 16 millones de interacciones con su modelo Claude, utilizando aproximadamente 24.000 cuentas fraudulentas.

Dentro de ese volumen, MiniMax habría generado más de 13 millones de consultas, mientras que Moonshot AI superó los 3,4 millones, enfocándose en áreas como razonamiento, programación y visión computacional.

Alianza inédita: compartir inteligencia entre competidores

Frente a esta amenaza, las principales empresas de IA de Estados Unidos —incluyendo OpenAI, Anthropic y Google— comenzaron a compartir información sobre patrones de ataque a través del Frontier Model Forum, una coalición creada en 2023 junto con Microsoft.

Este tipo de cooperación, inusual entre competidores directos, refleja la magnitud del problema. El objetivo es replicar modelos de colaboración propios de la ciberseguridad: cuando una empresa detecta una técnica de extracción, alerta al resto del ecosistema.

Respuesta política: sanciones y nueva legislación

El memorando de la Casa Blanca no introduce sanciones inmediatas, pero establece una hoja de ruta: compartir inteligencia con el sector privado, fortalecer defensas técnicas y explorar mecanismos de responsabilidad para actores extranjeros.

En paralelo, el Congreso ya avanza con iniciativas concretas. El 15 de abril se presentó el proyecto de ley Deterring American AI Model Theft Act of 2026, impulsado por el congresista Bill Huizenga. La propuesta busca identificar a entidades que utilicen técnicas de “consulta y copia” indebidas y aplicar sanciones a través de listas negras del Departamento de Comercio.

El desafío, sin embargo, es jurídico: aún no está claro si las respuestas generadas por modelos de IA pueden considerarse secretos comerciales bajo la legislación vigente.

Más allá de los chips: una nueva capa de la guerra tecnológica

Hasta ahora, la estrategia de Estados Unidos para limitar el avance tecnológico chino se había centrado en restringir el acceso a hardware, como chips avanzados de NVIDIA. Pero el caso de la destilación demuestra que ese enfoque es insuficiente.

Incluso con controles de exportación, existen vías alternativas: contrabando de hardware, desarrollo de chips locales o, como en este caso, replicación de capacidades vía software.

Esto obliga a repensar la estrategia en múltiples capas: controlar chips, proteger modelos y monitorear el uso de ambos.

El dilema del open source

El problema se agrava con los modelos de código abierto. Empresas como Meta liberaron modelos como Llama, cuyos pesos pueden descargarse libremente. Esto permite que investigadores —incluso vinculados a entornos militares— adapten la tecnología para nuevos usos.

Una vez publicado el modelo, el control es prácticamente imposible, lo que plantea una tensión estructural entre innovación abierta y seguridad nacional.

Geopolítica en primer plano

El anuncio llega en un momento clave: a tres semanas de una cumbre entre Donald Trump y Xi Jinping prevista para el 14 de mayo en Beijing.

En ese contexto, la inteligencia artificial se consolida como un activo estratégico, comparable a los semiconductores o la energía. Para Estados Unidos, proteger sus modelos es una cuestión de seguridad nacional. Para China, acceder a esas capacidades es clave para competir.