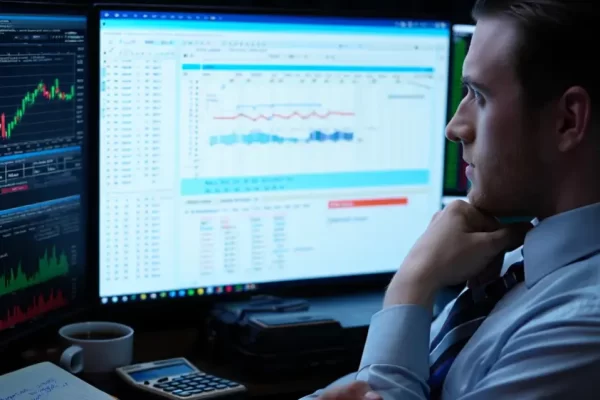

Claude: finanzas con integración en Excel y nuevos conectores de datos en tiempo real

La empresa detrás de Claude amplía sus soluciones con herramientas avanzadas para analistas e inversionistas. El asistente ahora puede conectar datos de mercado, elaborar modelos financieros y automatizar reportes directamente desde Excel. El ecosistema de inteligencia artificial aplicada a las finanzas suma un nuevo competidor de peso. Anthropic anunció una importante actualización de Claude for Financial Services, su…