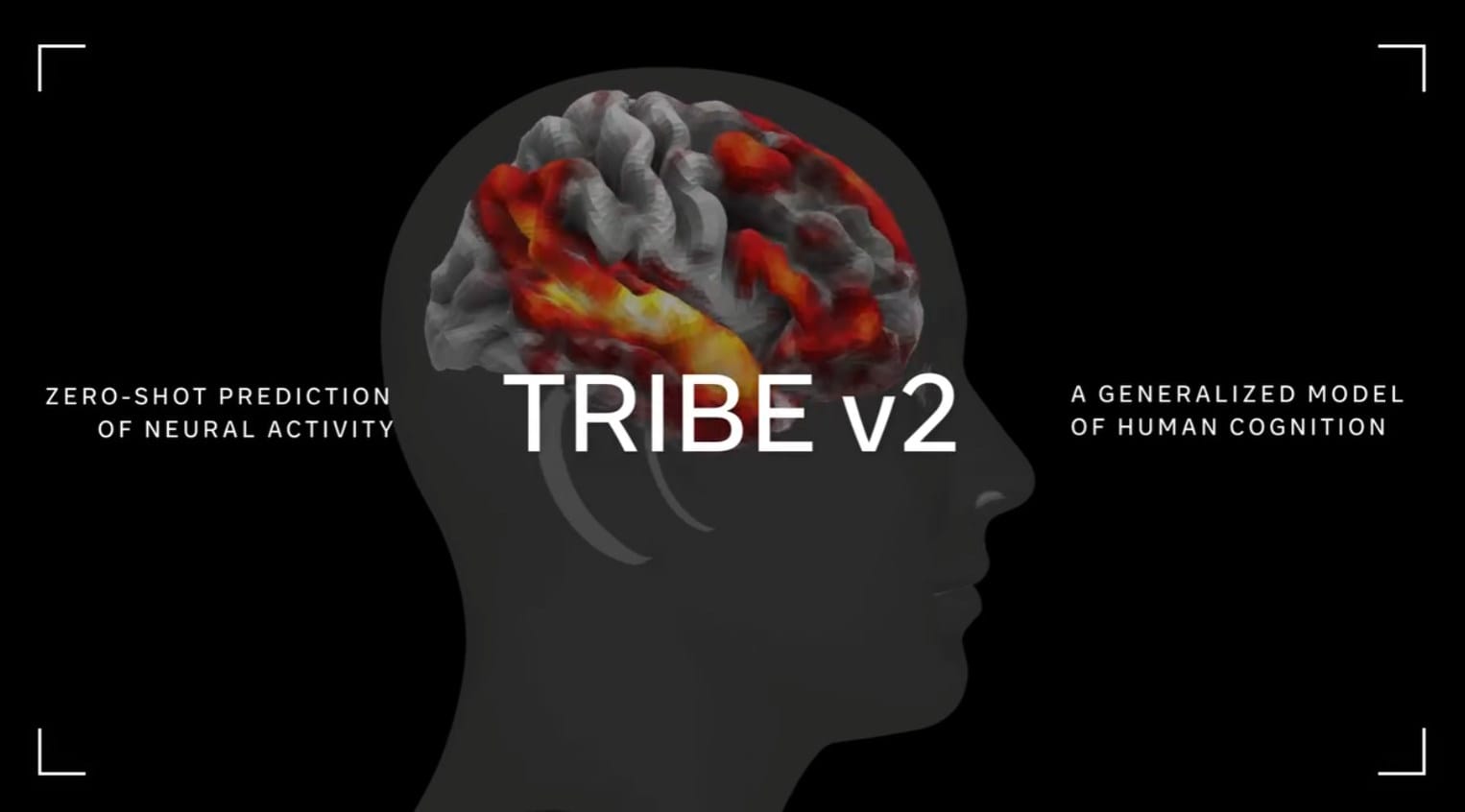

El avance de Meta combina visión, audio y lenguaje en un único modelo capaz de anticipar respuestas neuronales. Con más de 1000 horas de datos de 720 personas, abre la puerta a una nueva etapa en la neurociencia y la inteligencia artificial.

La inteligencia artificial sigue expandiendo sus fronteras y ahora apunta directamente al entendimiento del cerebro humano. Meta presentó TRIBE v2, un modelo fundacional trimodal que integra visión, audición y lenguaje con el objetivo de predecir la actividad cerebral en distintos contextos.

El desarrollo marca un avance significativo en un campo históricamente fragmentado. Hasta ahora, la neurociencia cognitiva trabajaba con modelos altamente especializados, diseñados para tareas o experimentos específicos, lo que dificultaba construir una visión unificada del funcionamiento del cerebro.

Un modelo unificado para entender la cognición

TRIBE v2 busca resolver ese problema. Se trata de un modelo de inteligencia artificial capaz de procesar simultáneamente video, audio y lenguaje, y traducir esos estímulos en predicciones sobre cómo responde el cerebro humano.

Para su entrenamiento, el sistema utilizó un dataset unificado de más de 1000 horas de resonancias magnéticas funcionales (fMRI), recopiladas de 720 sujetos. Esta escala de datos le permite capturar patrones complejos de actividad cerebral con un nivel de detalle superior al de modelos anteriores.

El resultado: TRIBE v2 logra predecir con precisión respuestas neuronales de alta resolución incluso frente a estímulos, tareas y personas nuevas, superando a los modelos de codificación lineal tradicionales.

De la observación a la simulación

Uno de los aspectos más disruptivos del modelo es su capacidad para habilitar experimentación “in silico”, es decir, simulaciones computacionales del comportamiento cerebral.

Esto implica que los investigadores pueden probar hipótesis, replicar experimentos clásicos y explorar nuevas condiciones sin necesidad de realizar estudios físicos con humanos en cada caso.

Según los resultados presentados, TRIBE v2 fue capaz de reproducir hallazgos consolidados durante décadas de investigación empírica en paradigmas visuales y neurolingüísticos.

La clave: integración multisensorial

Otro aporte relevante es la capacidad del modelo para identificar y mapear cómo el cerebro integra información de distintos sentidos.

A través de la extracción de características latentes interpretables, TRIBE v2 revela la topografía detallada de la integración multisensorial, un aspecto central para comprender cómo el cerebro procesa la realidad.

Este nivel de análisis permite avanzar no solo en neurociencia básica, sino también en aplicaciones potenciales en salud, interfaces cerebro-computadora y desarrollo de sistemas de IA más avanzados.

Inteligencia artificial como marco científico

Más allá del avance técnico, el trabajo de Meta plantea una tesis más ambiciosa: la inteligencia artificial como marco unificador para estudiar el cerebro humano.

En lugar de modelos aislados, TRIBE v2 propone una arquitectura capaz de generalizar entre distintos dominios, acercándose a una representación más integral de la cognición.

Implicancias y próximos pasos

El impacto potencial es amplio. Desde acelerar la investigación en enfermedades neurológicas hasta mejorar sistemas de interacción humano-máquina, el modelo abre nuevas líneas de trabajo.

Al mismo tiempo, también plantea interrogantes sobre el uso de datos neuronales, la interpretación de modelos complejos y los límites entre simulación y comprensión real del cerebro.

Lo que queda claro es que la convergencia entre inteligencia artificial y neurociencia está entrando en una nueva etapa.

Y con TRIBE v2, Meta busca posicionarse en el centro de esa transformación.